מדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.

-

@א.מ.ד. הי תודה ענקית על המדריך המושקע והמפורט

שהכל מונגש בו בצורה ברורה ומסודרת

אשמח לעזרה

אני עכשיו בדיוק מקים עוזר אישי של open claw על שרת המפרט של השרת שלי הוא

4 VCPUS

8 RAM

80 GB SSD

Traffic של 20TBהשרת הזה בעיקרון הוא רק בשבילו בלי עוד שום דבר אחר

אני רוצה שהוא יעבוד עם 2 שכבות של מודלים

מודל אחד מקומי שירוץ על השרת עם Ollama

והוא יענה על שאלות פשוטות שהוא יכול לענות עליהם וגם ידע להפנות שאלות מורכבות יותר

למודל גדול שאני יחבר עם API (עדיין לא סגור איזה) אז הוא ידע למי להפנות

ולכן מה שחשוב לי במודל זה יחסית בסיסי וקיים ברוב המודלים הידע לאן להפנות שאלות יותר קשות

אבל אם אני כבר מתקין מודל ויש לי את הנתוני חומרה אז אני רוצה לנצל אותם ולשים מודל כמה שיותר חכם שיחסוך לי קריאות APIעיקר השימוש שלי הוא לעוזר אישי לניהול משימות פחות דברים שקשורים בידע ואת הקידוד אני כנראה יפנה לקלוד קוד

ואסכם בשורה אחת איזה מודל מומלץ לי להרצה מקומית לפי כל המידע שהבאתי עד עכשיו

תודה רבה -

@עידו300 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד. זה אחד מהנסיונות gemma 3 4b instruct q4_k_m

זה Gemma 3, כן?

-

@א.מ.ד. כן, בעקבות המלצת @חובבן-מקצועי

@עידו300 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד. כן, בעקבות המלצת @חובבן-מקצועי

ולמה? מודל מלפני שנה וחצי בערך

-

@עידו300 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד. כן, בעקבות המלצת @חובבן-מקצועי

ולמה? מודל מלפני שנה וחצי בערך

@א.מ.ד. אולי כי הוא קיים גם ב9-12b ?

-

@עידו300 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד. כן, בעקבות המלצת @חובבן-מקצועי

ולמה? מודל מלפני שנה וחצי בערך

@א.מ.ד. כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

ולמה? מודל מלפני שנה וחצי בערך

כל עוד איננו יודעים (ומחכים להסבר של @א.מ.ד. ) כיצד להשבית את הליך החשיבה, אם המחשב איטי מאוד, זה מאוד מקשה. (תחשוב ש90 אחוז מהמילים שהוא כותב זה בכלל להליך החשיבה..)

(הוא הזכיר לעיל שיש לו רק 2 ליבות מעבד..)

-

@א.מ.ד. כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

ולמה? מודל מלפני שנה וחצי בערך

כל עוד איננו יודעים (ומחכים להסבר של @א.מ.ד. ) כיצד להשבית את הליך החשיבה, אם המחשב איטי מאוד, זה מאוד מקשה. (תחשוב ש90 אחוז מהמילים שהוא כותב זה בכלל להליך החשיבה..)

(הוא הזכיר לעיל שיש לו רק 2 ליבות מעבד..)

@חובבן-מקצועי בסדר אני יוסיף למדריך איך להשבית את הליך החשיבה

-

א א.מ.ד. התייחס לנושא זה

א א.מ.ד. התייחס לנושא זה

-

@א.מ.ד. כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

ולמה? מודל מלפני שנה וחצי בערך

כל עוד איננו יודעים (ומחכים להסבר של @א.מ.ד. ) כיצד להשבית את הליך החשיבה, אם המחשב איטי מאוד, זה מאוד מקשה. (תחשוב ש90 אחוז מהמילים שהוא כותב זה בכלל להליך החשיבה..)

(הוא הזכיר לעיל שיש לו רק 2 ליבות מעבד..)

-

@CUBASE כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד. זה לא צוין במדריך של @חובבן-מקצועי , כדאי שיעודכן

בכל אופן תודה רבה!, נראה מה הלאה..

כתב במדריך | מדריך בסיסי להתקנה ושימוש במודלים ב-LM Studio:

עכשיו צריך להגדיר לתוכנה בהגדרות מאיפה לקחת את קבצי ה gguf.

בשביל שהתוכנה תקרא את קבצי הgguf אתם צריכים ליצור תיקיות בסדר של תיקייה בתוך תייקיה בתוך תיקייה. הסדר המומלץ לדעתי הוא LM_models/manual><name_model>/file.gguf - (למי שלא הבין - name_model - היינו תוסיפו תיקייה בשם של המודל שלכם. וfile.gguf - זה הקובץ של המודל שפה עצמו).דווקא כן כתוב.. (אולי בלי ההסבר של @ א.מ.ד. למה זה ככה, אבל בהחלט כתבתי שזה צריך להיות תיקייה בתוך תיקייה בתוך תיקייה.. (אגב, זה לא משנה השם, אפילו נתיב של

1/2/3/the_model.ggufיעבוד. (אם תבחר בLM studio את התייקיה 1)

@חובבן-מקצועי כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

דווקא כן כתוב..

לא בדיוק, כתבת

LM_models/manual><name_model>/file.gguf,

ה-**<**manualבלבל אותי, תתקן ל-LM_models/manual/<name_model>/file.ggufבעצם ערבבת בין

/מפריד ל-< -

@חובבן-מקצועי כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

דווקא כן כתוב..

לא בדיוק, כתבת

LM_models/manual><name_model>/file.gguf,

ה-**<**manualבלבל אותי, תתקן ל-LM_models/manual/<name_model>/file.ggufבעצם ערבבת בין

/מפריד ל-<@CUBASE צודק. תיקנתי.

(אגב, היית יכול להבין את זה ממה שכתבתי תיקייה בתוך תייקיה בתוך תיקייה...)

-

@CUBASE צודק. תיקנתי.

(אגב, היית יכול להבין את זה ממה שכתבתי תיקייה בתוך תייקיה בתוך תיקייה...)

@חובבן-מקצועי נכון, אבל דווקא הדוגמא היא זו שגרמה לי לפקפק בהבנה של הדברים

-

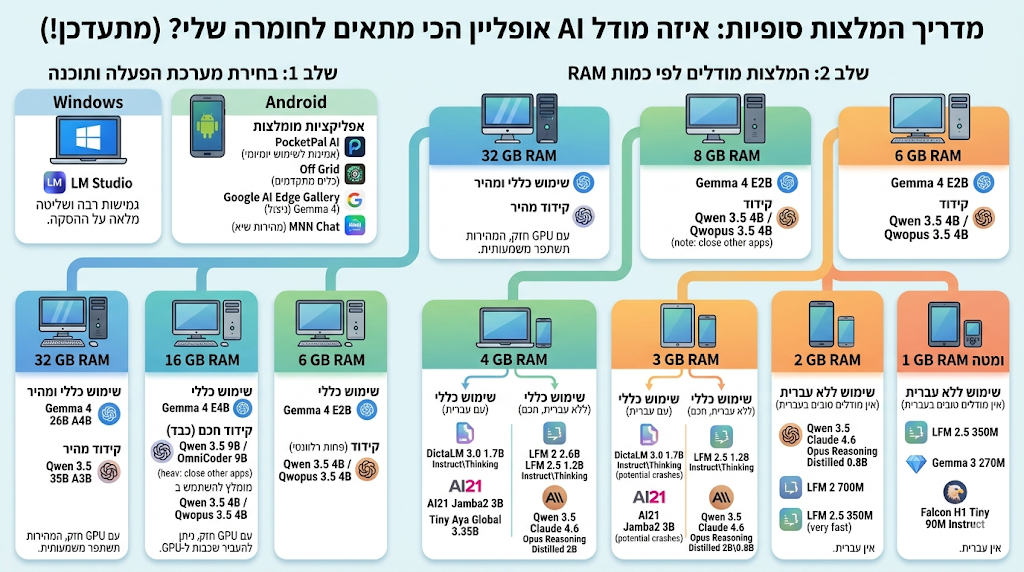

יש מודלים שמתאימים גם לאייפד?

תודה רבה

-

@עידו300 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

נשמח שתוסיף גם את הembedding.

לא קשור להרצת מודלים, או למודלי LLM בכללי.

@אליהו-הגדול כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

יש מודלים שמתאימים גם לאייפד?

כן.

תבדוק את המפרט שלך ותתאים לפי זה.

באייפד יש עניין נוסף שיש את השבב ANE. צריך להשתמש בפורמט של אפל שנקרא Core ML. -

איך עושים זאת?

-

איך עושים זאת?

@אליהו-הגדול בדיקת מפרט? אין לי אייפד, אבל זה אמור להיות באודות בהגדרות.

-

תודה רבה

-

איך עושים זאת?

@אליהו-הגדול אפליקציית PocketPal AI מיועדת גם ל-IOS.

-

@אליהו-הגדול אפליקציית PocketPal AI מיועדת גם ל-IOS.

-

@א.מ.ד. כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

אפליקציית PocketPal AI מיועדת גם ל-IOS

הוא לא התכוון לשכבת הרצה אלא למודל. כך למיטב הבנתי.

@המלאך

תמיד ידעתי שאני מסתדר טוב עם 'מלאכים'...

רק הם מבינים אותי מדויק ומקצועי!!!