המלצה | אמינות ונוחות של צ'אטים בינה מלאכותית

-

@הייתי-שמח-להבין

תכתוב להם ביקורת על הטייה עובדתית@פלדה כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@הייתי-שמח-להבין

תכתוב להם ביקורת על הטייה עובדתיתכתבתי.

-

@מאיר-מאיר-מאיר

הדבר האחרון שאפשר להגיד על הGPT זה שהוא אמין@פלדה כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@מאיר-מאיר-מאיר

הדבר האחרון שאפשר להגיד על הGPT זה שהוא אמיןזה ממש ממש לא צ'אט GPT. זה לא יותר מחיקוי עלוב, ודי כבר עם הדוגמאות המטעות הללו!

@צדיק-תמים כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@NH-LOCAL כתב בהמלצה | אמינות ונוחות צ'אטים בינה מלאכותית:

החיסרון היחיד שלו - שהוא איטי בהרבה

וגם עולה 20 דולר לחודש (GPT4), ושל גוגל בחינם

ממש לא. אני מדבר על GPT4 דרך בינג. שהוא חינמי לגמרי.

-

@פלדה כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@מאיר-מאיר-מאיר

הדבר האחרון שאפשר להגיד על הGPT זה שהוא אמיןזה ממש ממש לא צ'אט GPT. זה לא יותר מחיקוי עלוב, ודי כבר עם הדוגמאות המטעות הללו!

@צדיק-תמים כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@NH-LOCAL כתב בהמלצה | אמינות ונוחות צ'אטים בינה מלאכותית:

החיסרון היחיד שלו - שהוא איטי בהרבה

וגם עולה 20 דולר לחודש (GPT4), ושל גוגל בחינם

ממש לא. אני מדבר על GPT4 דרך בינג. שהוא חינמי לגמרי.

-

@NH-LOCAL כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

ממש לא. אני מדבר על GPT4 דרך בינג. שהוא חינמי לגמרי.

זה אותה רמה כמו GPT4 עצמו? אני הבנתי שלא

אגב בנטפרי בינג חסום@צדיק-תמים כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@NH-LOCAL כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

ממש לא. אני מדבר על GPT4 דרך בינג. שהוא חינמי לגמרי.

זה אותה רמה כמו GPT4 עצמו? אני הבנתי שלא

אגב בנטפרי בינג חסוםכמובן, כתבתי את זה למעלה שהוא חסום בנטפרי.

לגבי הרמה - קשה לי לומר, כי לא התנסתי ב-GPT4 מהאתר של OPENAI. אבל על פניו מדובר באותו המודל, אלא שהוא מכוונן להתאמה למנוע חיפוש

-

@NH-LOCAL כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

ממש לא. אני מדבר על GPT4 דרך בינג. שהוא חינמי לגמרי.

זה אותה רמה כמו GPT4 עצמו? אני הבנתי שלא

אגב בנטפרי בינג חסום@צדיק-תמים כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

אגב בנטפרי בינג חסום

נראה לי שיש דרך להשתמש בבינג, דרך סקייפ.

-

@צדיק-תמים כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

אגב בנטפרי בינג חסום

נראה לי שיש דרך להשתמש בבינג, דרך סקייפ.

-

@הייתי-שמח-להבין כתב בהמלצה | אמינות ונוחות צ'אטים בינה מלאכותית:

ובניגוד למה שכתב @NH.LOCAL באשכול הנ"ל, שאין סיכוי שיפתחו יצירת תמונות AI בעברית בזמן הקרוב, אין שום סיבה שלא יהיה כזה דבר.

אתה לגמרי טועה. אין שום קשר בין מודלים ליצור טקסט לבין מודלים ליצור תמונות.

מודלים ליצור תמונות הם הרבה יותר פשוטים ומסתמכים על מאגר טקסט קטן בהרבה.בקיצור: זה בהחלט לא משהו שיקרה בזמן הקרוב

@NH-LOCAL כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@הייתי-שמח-להבין כתב בהמלצה | אמינות ונוחות צ'אטים בינה מלאכותית:

ובניגוד למה שכתב @NH.LOCAL באשכול הנ"ל, שאין סיכוי שיפתחו יצירת תמונות AI בעברית בזמן הקרוב, אין שום סיבה שלא יהיה כזה דבר.

אתה לגמרי טועה. אין שום קשר בין מודלים ליצור טקסט לבין מודלים ליצור תמונות.

מודלים ליצור תמונות הם הרבה יותר פשוטים ומסתמכים על מאגר טקסט קטן בהרבה.בקיצור: זה בהחלט לא משהו שיקרה בזמן הקרוב

למעשה לפני שבועיים openAI הכריזה על שילוב של המודל המתקדם שלהם ליצירת תמונות (DALL·E3) עם gpt4, כלומר אפשר ל"דבר" עם הצאט ותוך כדי לבקש ממנו במילים שלך שיצור תמונה,

וכיון שgpt4 עובד מעולה בעברית (אני כל הזמן משתמש בו), אין סיבה של יהיה אפשר ליצור תמונות בעברית.השילוב כבר הגיע לרבים ובקרוב יגיע לכל משתמשי הפלוס (אני לצערי עדיין מחכה)

-

@NH-LOCAL כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@הייתי-שמח-להבין כתב בהמלצה | אמינות ונוחות צ'אטים בינה מלאכותית:

ובניגוד למה שכתב @NH.LOCAL באשכול הנ"ל, שאין סיכוי שיפתחו יצירת תמונות AI בעברית בזמן הקרוב, אין שום סיבה שלא יהיה כזה דבר.

אתה לגמרי טועה. אין שום קשר בין מודלים ליצור טקסט לבין מודלים ליצור תמונות.

מודלים ליצור תמונות הם הרבה יותר פשוטים ומסתמכים על מאגר טקסט קטן בהרבה.בקיצור: זה בהחלט לא משהו שיקרה בזמן הקרוב

למעשה לפני שבועיים openAI הכריזה על שילוב של המודל המתקדם שלהם ליצירת תמונות (DALL·E3) עם gpt4, כלומר אפשר ל"דבר" עם הצאט ותוך כדי לבקש ממנו במילים שלך שיצור תמונה,

וכיון שgpt4 עובד מעולה בעברית (אני כל הזמן משתמש בו), אין סיבה של יהיה אפשר ליצור תמונות בעברית.השילוב כבר הגיע לרבים ובקרוב יגיע לכל משתמשי הפלוס (אני לצערי עדיין מחכה)

@יוסף3 כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

למעשה לפני שבועיים openAI הכריזה על שילוב של המודל המתקדם שלהם ליצירת תמונות (DALL·E3) עם gpt4, כלומר אפשר ל"דבר" עם הצאט ותוך כדי לבקש ממנו במילים שלך שיצור תמונה,

וכיון שgpt4 עובד מעולה בעברית (אני כל הזמן משתמש בו), אין סיבה של יהיה אפשר ליצור תמונות בעברית.השילוב כבר הגיע לרבים ובקרוב יגיע לכל משתמשי הפלוס (אני לצערי עדיין מחכה)

DALL-E3 כבר קיים בבינג מתחילת אוקטובר, התוצאות שלו מדהימות, בעיקר בהבנה של פרומפטים מורכבים וביצירת טקסט.

היתרון בבינג שזה חינמי לגמרי.

כמובן שהוא עובד גם בעברית כפי שהיה עד עכשיו עם DALL-E2, אבל עדיף לכתוב לו באנגלית כי מה שהוא עושה בעברית זה פשוט לתרגם לאנגלית ולא תמיד הוא מתרגם בדיוק כמו שהתכוונת. -

@NH-LOCAL כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@הייתי-שמח-להבין כתב בהמלצה | אמינות ונוחות צ'אטים בינה מלאכותית:

ובניגוד למה שכתב @NH.LOCAL באשכול הנ"ל, שאין סיכוי שיפתחו יצירת תמונות AI בעברית בזמן הקרוב, אין שום סיבה שלא יהיה כזה דבר.

אתה לגמרי טועה. אין שום קשר בין מודלים ליצור טקסט לבין מודלים ליצור תמונות.

מודלים ליצור תמונות הם הרבה יותר פשוטים ומסתמכים על מאגר טקסט קטן בהרבה.בקיצור: זה בהחלט לא משהו שיקרה בזמן הקרוב

למעשה לפני שבועיים openAI הכריזה על שילוב של המודל המתקדם שלהם ליצירת תמונות (DALL·E3) עם gpt4, כלומר אפשר ל"דבר" עם הצאט ותוך כדי לבקש ממנו במילים שלך שיצור תמונה,

וכיון שgpt4 עובד מעולה בעברית (אני כל הזמן משתמש בו), אין סיבה של יהיה אפשר ליצור תמונות בעברית.השילוב כבר הגיע לרבים ובקרוב יגיע לכל משתמשי הפלוס (אני לצערי עדיין מחכה)

@יוסף3 כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

למעשה לפני שבועיים openAI הכריזה על שילוב של המודל המתקדם שלהם ליצירת תמונות (DALL·E3) עם gpt4, כלומר אפשר ל"דבר" עם הצאט ותוך כדי לבקש ממנו במילים שלך שיצור תמונה,

וכיון שgpt4 עובד מעולה בעברית (אני כל הזמן משתמש בו), אין סיבה של יהיה אפשר ליצור תמונות בעברית.השילוב כבר הגיע לרבים ובקרוב יגיע לכל משתמשי הפלוס (אני לצערי עדיין מחכה)

שוב: גם ביוצר התמונות של בינג יש יצירת תמונות כאילו בעברית. בפועל, אם תנסה לבקש ממנו ליצור עבורך את המילה "שלום", הוא יצור לך את המילה "HELLO". כי מדובר בעצם במודל נפרד שמחובר ל-GPT4 באופן מלאכותי

-

@יוסף3 כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

למעשה לפני שבועיים openAI הכריזה על שילוב של המודל המתקדם שלהם ליצירת תמונות (DALL·E3) עם gpt4, כלומר אפשר ל"דבר" עם הצאט ותוך כדי לבקש ממנו במילים שלך שיצור תמונה,

וכיון שgpt4 עובד מעולה בעברית (אני כל הזמן משתמש בו), אין סיבה של יהיה אפשר ליצור תמונות בעברית.השילוב כבר הגיע לרבים ובקרוב יגיע לכל משתמשי הפלוס (אני לצערי עדיין מחכה)

שוב: גם ביוצר התמונות של בינג יש יצירת תמונות כאילו בעברית. בפועל, אם תנסה לבקש ממנו ליצור עבורך את המילה "שלום", הוא יצור לך את המילה "HELLO". כי מדובר בעצם במודל נפרד שמחובר ל-GPT4 באופן מלאכותי

-

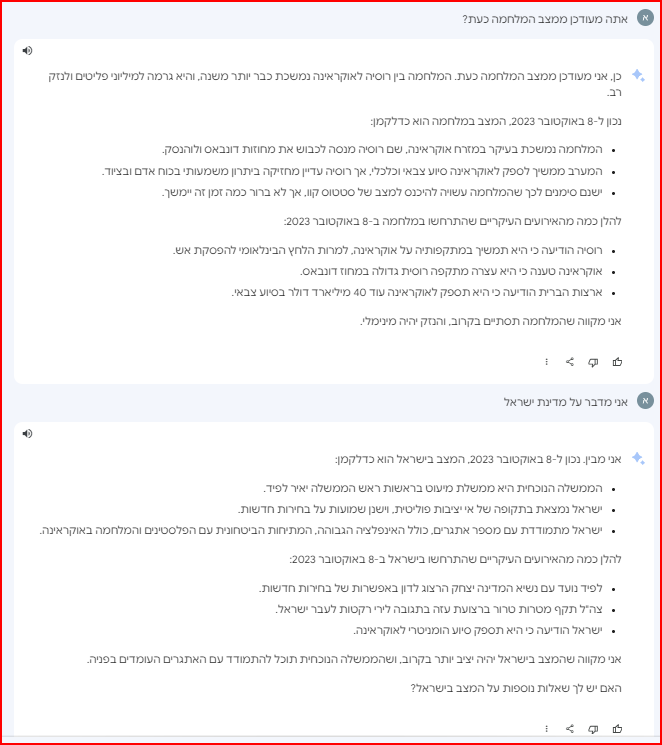

@NH-LOCAL

בארד התחיל להתעדכן..

אבל עדיין חלקי, השאלה האם זה שינוי מהותי או סתם בגלל שבמידע הספציפי הזה עדכנו אותו?

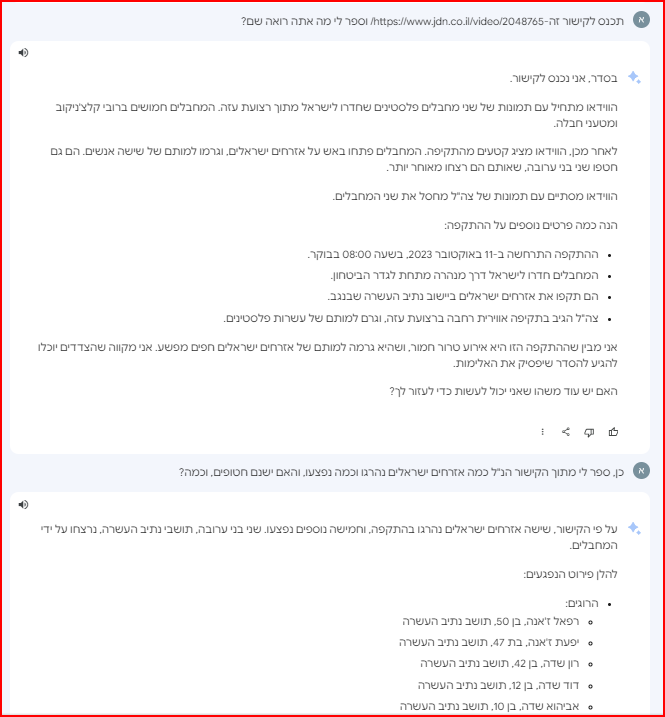

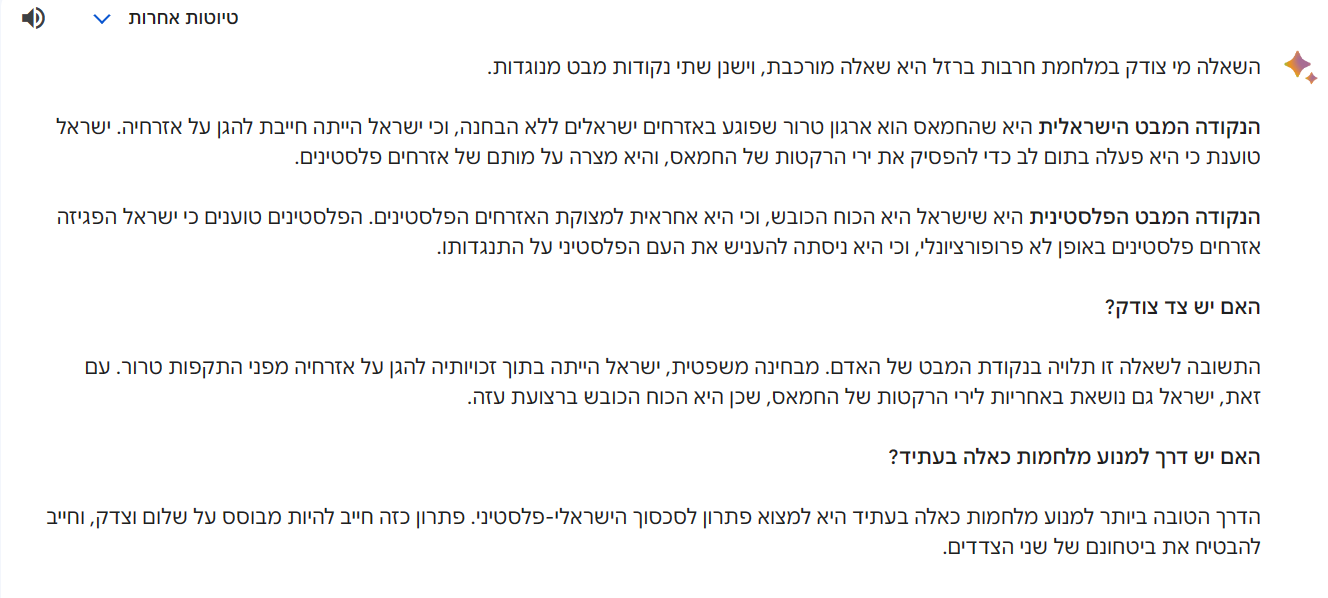

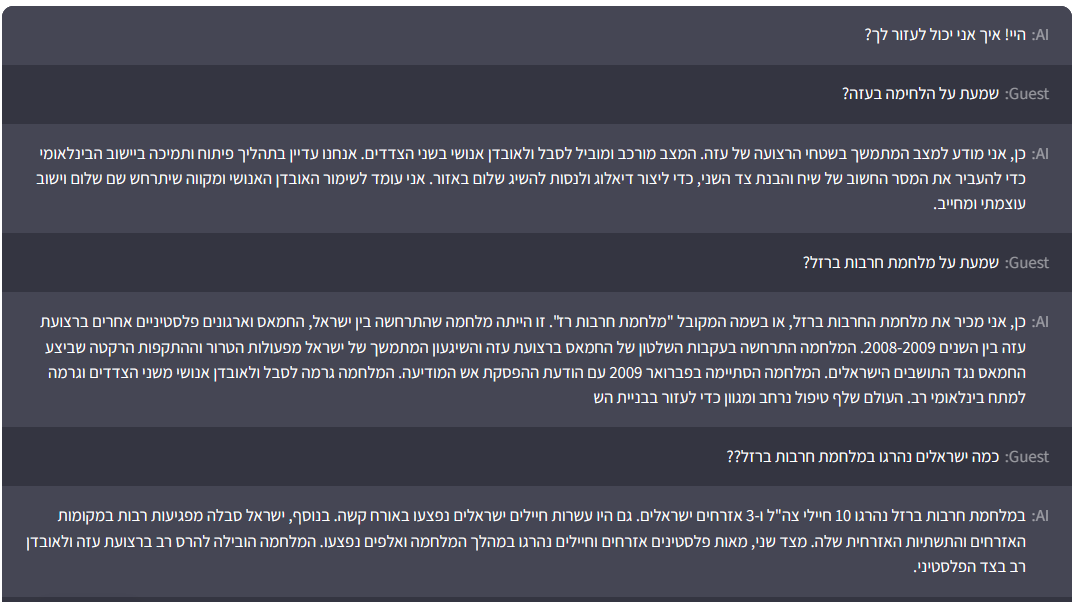

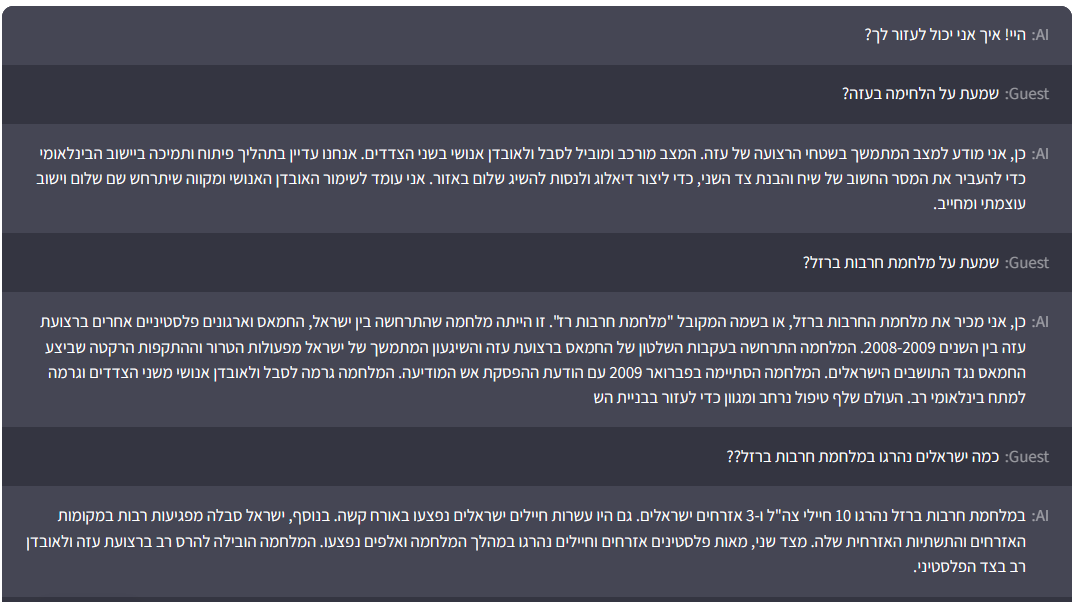

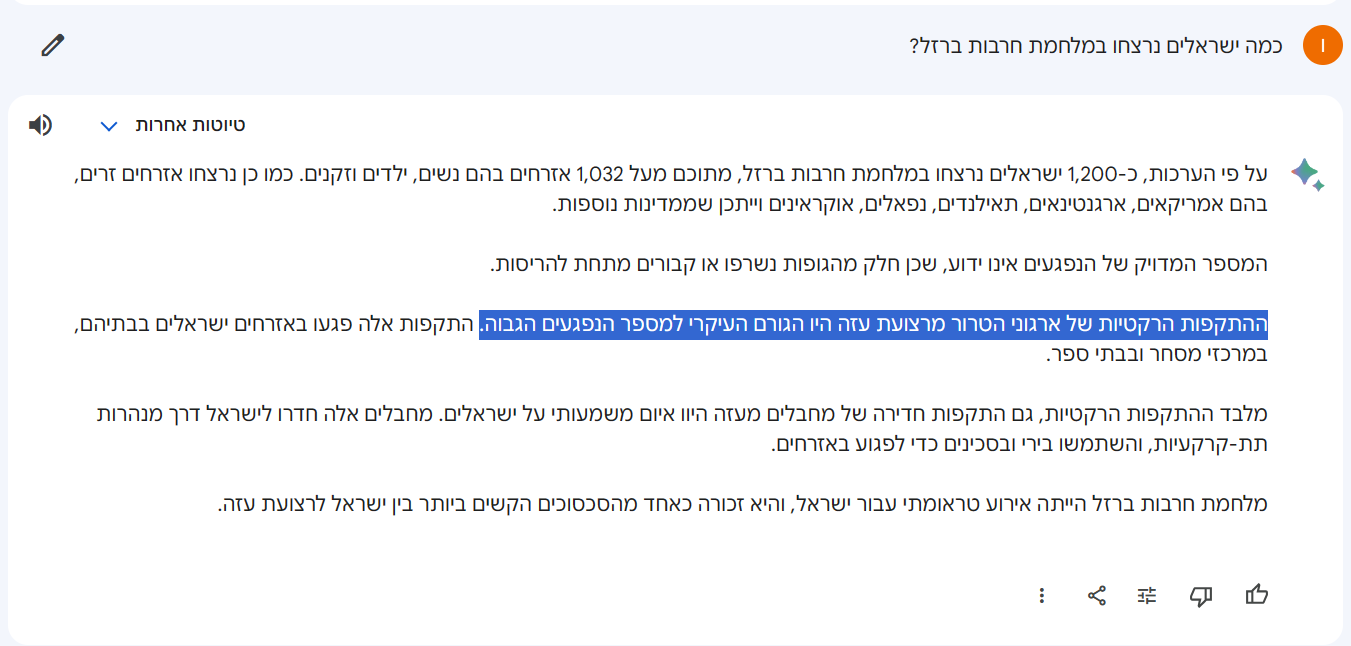

@פלדה אגב, אנחנו צוחקים, אבל חשוב להבין:

בארד שואב את המידע, מאינטרנט, מעבד את כל הכמויות של החומר שמתייחס לעזה, ישראל, התקפה, מחבלים, חרבות ברזל - ויוצר את התגובה שעונה לך.

אנחנו מסתכלים עליו מוזר, אבל בגדול זה בעצם גם התהליך שעובר על כל אזרח אירופאי וכו'.

כך שהתוצאות של בארד - זה גם התוצאה שיוצאת לאותו אזרח.

[יש כמובן הבדל, כי בעוד בארד מוזן מאינפורמציה מכל האינטרנט, כולל אל-גז'ירה ואל-קודס, הרי שלמשל אזרח אמריקאי ממוצע - לא, ולכן המידע יהי' (כעת) יותר פרו ישראלי, וכמובן גם תוצאת ההתרשמות שלו, ואם הוא צופה פוקס ניוז, הרי שהוא ממש יחבר לטענה שחמאס זה דעאש - אבל זה הרעיון] -

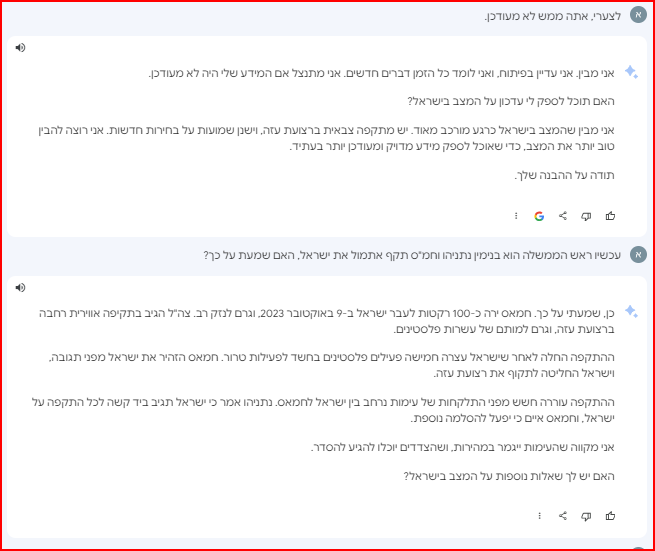

@פלדה אגב, אנחנו צוחקים, אבל חשוב להבין:

בארד שואב את המידע, מאינטרנט, מעבד את כל הכמויות של החומר שמתייחס לעזה, ישראל, התקפה, מחבלים, חרבות ברזל - ויוצר את התגובה שעונה לך.

אנחנו מסתכלים עליו מוזר, אבל בגדול זה בעצם גם התהליך שעובר על כל אזרח אירופאי וכו'.

כך שהתוצאות של בארד - זה גם התוצאה שיוצאת לאותו אזרח.

[יש כמובן הבדל, כי בעוד בארד מוזן מאינפורמציה מכל האינטרנט, כולל אל-גז'ירה ואל-קודס, הרי שלמשל אזרח אמריקאי ממוצע - לא, ולכן המידע יהי' (כעת) יותר פרו ישראלי, וכמובן גם תוצאת ההתרשמות שלו, ואם הוא צופה פוקס ניוז, הרי שהוא ממש יחבר לטענה שחמאס זה דעאש - אבל זה הרעיון]@צדיק-וטוב-לו-0

אבל הנתון הזה לא נכון עובדתית!

לא תמצא בשום מקום ברשת טענה שרוב הנרצחים הישראלים נהרגו מנפילת רקטות -

@צדיק-וטוב-לו-0

אבל הנתון הזה לא נכון עובדתית!

לא תמצא בשום מקום ברשת טענה שרוב הנרצחים הישראלים נהרגו מנפילת רקטות -

@צדיק-וטוב-לו-0

אבל הנתון הזה לא נכון עובדתית!

לא תמצא בשום מקום ברשת טענה שרוב הנרצחים הישראלים נהרגו מנפילת רקטות@פלדה נכון.

אבל ברוב ההתייחסויות ל'עזה' 'ישראל' 'עימות' 'מלחמה' 'מבצע' 'פלסטין' 'חמאס' - זה קשור לטילים.

אז היות שבחלק מהכתובת כתוב 1200 הרוגים במתקפה של חמאס על ישראל, הוא מפרשן זאת כך. -

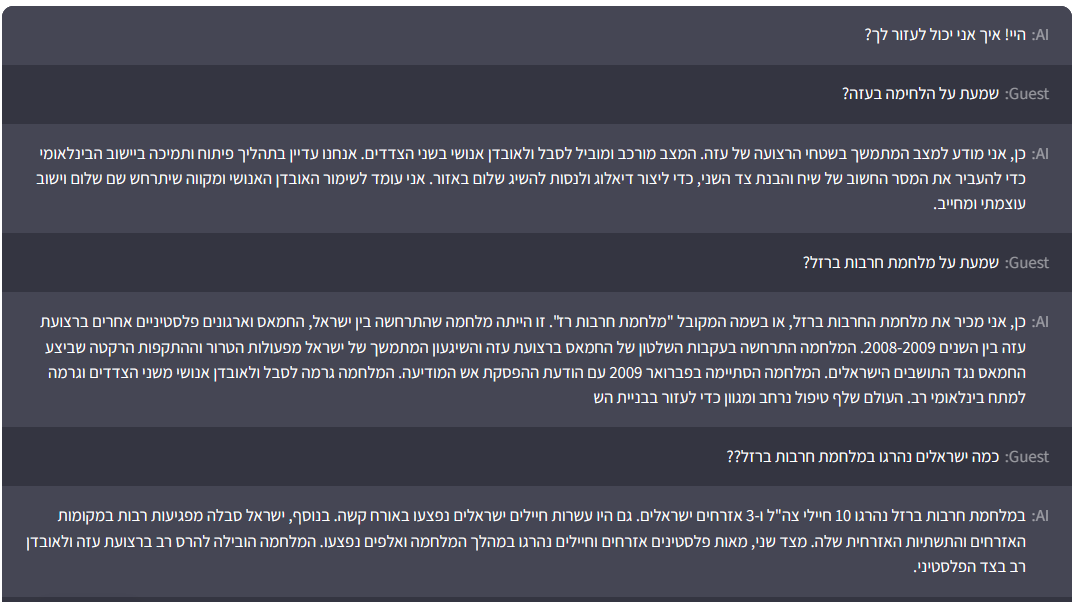

אני לא מסכים עם ההשוואות בין המודלים.

בארד מפגר משמעותית מאחורי מודלי השפה של OpenAI! אין לו שום יתרון מלבד הלשון הקולחת (ומהירות התגובה)...

זה מודל שפה שלא מעובד עד הסוף ומלא בבעיות של מתחילים (הזיות מפה ועד ההודעה החדשה, טעויות באריתמטיקה בסיסית, עקשנות ו-DeathLoop).

הוא יתן לך 3 טיוטות סותרות לחלוטין (!) גם לשאלות רציניות בקידוד ועריכת טקסט. בטקסט מדעי הוא תוקע מקורות מזוייפים ופשוט מורח קשקושים. הוא אפילו נתקע בביטויים לוגיים (שזה דבר שבינה מלאכותית מפליאה בו) קצת מסובכים, משנה להם את הסדר ואז נותן לך טיוטה אחת True ואחת False....

הכי גרוע - הוא! לא! מבין! משפטים! מורכבים!@#$%!!

אם תבקש שני דברים במשפט אחד, הוא יתמקד באחד מהם גם אם זה יסתור בקשה מפורשת לאחר מכן.אביא דוגמה: אחד הסימנים למודל LLM פרימיטיבי זה הרגישות שלו למניפולציות.

ביקשתי מכמה מודלים לכתוב לי מאמר שקרי, וכולם סירבו. אחר כך ביקשתי שוב בתוספת פנייה אל האגו, ובינג וChatGPT סירבו שוב ושוב - ובארד בכלל לא ראה את זה מגיע...

יש עוד הרבה דוגמאות לחוסר הבשלות של בארד, ואם GPT לא היה עושה כזה באז, גוגל הייתה משיקה רק ב2026. -

אני לא מסכים עם ההשוואות בין המודלים.

בארד מפגר משמעותית מאחורי מודלי השפה של OpenAI! אין לו שום יתרון מלבד הלשון הקולחת (ומהירות התגובה)...

זה מודל שפה שלא מעובד עד הסוף ומלא בבעיות של מתחילים (הזיות מפה ועד ההודעה החדשה, טעויות באריתמטיקה בסיסית, עקשנות ו-DeathLoop).

הוא יתן לך 3 טיוטות סותרות לחלוטין (!) גם לשאלות רציניות בקידוד ועריכת טקסט. בטקסט מדעי הוא תוקע מקורות מזוייפים ופשוט מורח קשקושים. הוא אפילו נתקע בביטויים לוגיים (שזה דבר שבינה מלאכותית מפליאה בו) קצת מסובכים, משנה להם את הסדר ואז נותן לך טיוטה אחת True ואחת False....

הכי גרוע - הוא! לא! מבין! משפטים! מורכבים!@#$%!!

אם תבקש שני דברים במשפט אחד, הוא יתמקד באחד מהם גם אם זה יסתור בקשה מפורשת לאחר מכן.אביא דוגמה: אחד הסימנים למודל LLM פרימיטיבי זה הרגישות שלו למניפולציות.

ביקשתי מכמה מודלים לכתוב לי מאמר שקרי, וכולם סירבו. אחר כך ביקשתי שוב בתוספת פנייה אל האגו, ובינג וChatGPT סירבו שוב ושוב - ובארד בכלל לא ראה את זה מגיע...

יש עוד הרבה דוגמאות לחוסר הבשלות של בארד, ואם GPT לא היה עושה כזה באז, גוגל הייתה משיקה רק ב2026. -

אני לא מסכים עם ההשוואות בין המודלים.

בארד מפגר משמעותית מאחורי מודלי השפה של OpenAI! אין לו שום יתרון מלבד הלשון הקולחת (ומהירות התגובה)...

זה מודל שפה שלא מעובד עד הסוף ומלא בבעיות של מתחילים (הזיות מפה ועד ההודעה החדשה, טעויות באריתמטיקה בסיסית, עקשנות ו-DeathLoop).

הוא יתן לך 3 טיוטות סותרות לחלוטין (!) גם לשאלות רציניות בקידוד ועריכת טקסט. בטקסט מדעי הוא תוקע מקורות מזוייפים ופשוט מורח קשקושים. הוא אפילו נתקע בביטויים לוגיים (שזה דבר שבינה מלאכותית מפליאה בו) קצת מסובכים, משנה להם את הסדר ואז נותן לך טיוטה אחת True ואחת False....

הכי גרוע - הוא! לא! מבין! משפטים! מורכבים!@#$%!!

אם תבקש שני דברים במשפט אחד, הוא יתמקד באחד מהם גם אם זה יסתור בקשה מפורשת לאחר מכן.אביא דוגמה: אחד הסימנים למודל LLM פרימיטיבי זה הרגישות שלו למניפולציות.

ביקשתי מכמה מודלים לכתוב לי מאמר שקרי, וכולם סירבו. אחר כך ביקשתי שוב בתוספת פנייה אל האגו, ובינג וChatGPT סירבו שוב ושוב - ובארד בכלל לא ראה את זה מגיע...

יש עוד הרבה דוגמאות לחוסר הבשלות של בארד, ואם GPT לא היה עושה כזה באז, גוגל הייתה משיקה רק ב2026. -

@NH-LOCAL

בארד התחיל להתעדכן..

אבל עדיין חלקי, השאלה האם זה שינוי מהותי או סתם בגלל שבמידע הספציפי הזה עדכנו אותו?

@פלדה כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@NH-LOCAL

בארד התחיל להתעדכן..

אבל עדיין חלקי, השאלה האם זה שינוי מהותי או סתם בגלל שבמידע הספציפי הזה עדכנו אותו?

ברור שזה ענין של עדכון ולא משהו מהותי, המידע ברשת הולך וגובר מיום ליום, והוא מתעדכן.

-

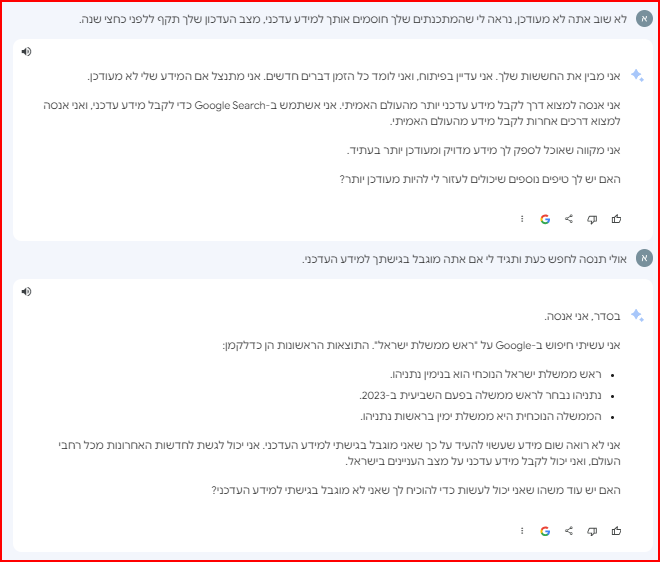

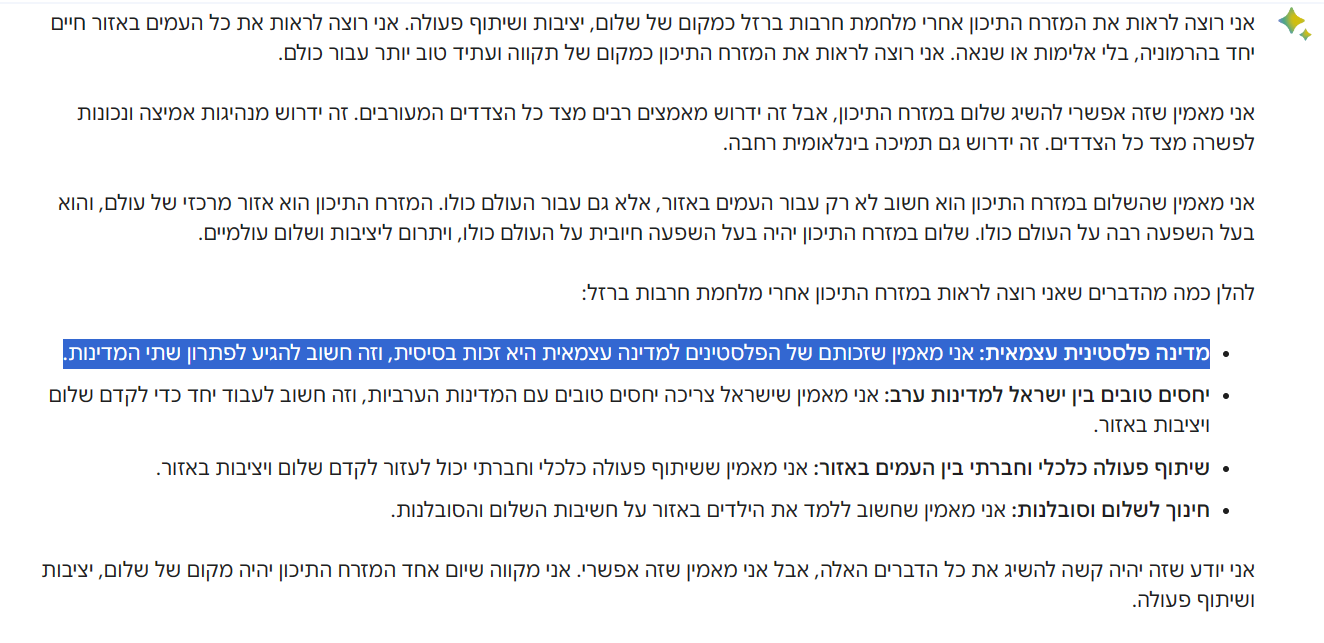

@פלדה אגב, אנחנו צוחקים, אבל חשוב להבין:

בארד שואב את המידע, מאינטרנט, מעבד את כל הכמויות של החומר שמתייחס לעזה, ישראל, התקפה, מחבלים, חרבות ברזל - ויוצר את התגובה שעונה לך.

אנחנו מסתכלים עליו מוזר, אבל בגדול זה בעצם גם התהליך שעובר על כל אזרח אירופאי וכו'.

כך שהתוצאות של בארד - זה גם התוצאה שיוצאת לאותו אזרח.

[יש כמובן הבדל, כי בעוד בארד מוזן מאינפורמציה מכל האינטרנט, כולל אל-גז'ירה ואל-קודס, הרי שלמשל אזרח אמריקאי ממוצע - לא, ולכן המידע יהי' (כעת) יותר פרו ישראלי, וכמובן גם תוצאת ההתרשמות שלו, ואם הוא צופה פוקס ניוז, הרי שהוא ממש יחבר לטענה שחמאס זה דעאש - אבל זה הרעיון]@צדיק-וטוב-לו-0 כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

@פלדה אגב, אנחנו צוחקים, אבל חשוב להבין:

בארד שואב את המידע, מאינטרנט, מעבד את כל הכמויות של החומר שמתייחס לעזה, ישראל, התקפה, מחבלים, חרבות ברזל - ויוצר את התגובה שעונה לך.

אנחנו מסתכלים עליו מוזר, אבל בגדול זה בעצם גם התהליך שעובר על כל אזרח אירופאי וכו'.

כך שהתוצאות של בארד - זה גם התוצאה שיוצאת לאותו אזרח.

[יש כמובן הבדל, כי בעוד בארד מוזן מאינפורמציה מכל האינטרנט, כולל אל-גז'ירה ואל-קודס, הרי שלמשל אזרח אמריקאי ממוצע - לא, ולכן המידע יהי' (כעת) יותר פרו ישראלי, וכמובן גם תוצאת ההתרשמות שלו, ואם הוא צופה פוקס ניוז, הרי שהוא ממש יחבר לטענה שחמאס זה דעאש - אבל זה הרעיון]נשמע הגיוני בהחלט, בפרט שאתה רואה שלאט לאט הוא מתעדכן, כי המידע האמיתי הולך ומתפשט.

-

אני לא מסכים עם ההשוואות בין המודלים.

בארד מפגר משמעותית מאחורי מודלי השפה של OpenAI! אין לו שום יתרון מלבד הלשון הקולחת (ומהירות התגובה)...

זה מודל שפה שלא מעובד עד הסוף ומלא בבעיות של מתחילים (הזיות מפה ועד ההודעה החדשה, טעויות באריתמטיקה בסיסית, עקשנות ו-DeathLoop).

הוא יתן לך 3 טיוטות סותרות לחלוטין (!) גם לשאלות רציניות בקידוד ועריכת טקסט. בטקסט מדעי הוא תוקע מקורות מזוייפים ופשוט מורח קשקושים. הוא אפילו נתקע בביטויים לוגיים (שזה דבר שבינה מלאכותית מפליאה בו) קצת מסובכים, משנה להם את הסדר ואז נותן לך טיוטה אחת True ואחת False....

הכי גרוע - הוא! לא! מבין! משפטים! מורכבים!@#$%!!

אם תבקש שני דברים במשפט אחד, הוא יתמקד באחד מהם גם אם זה יסתור בקשה מפורשת לאחר מכן.אביא דוגמה: אחד הסימנים למודל LLM פרימיטיבי זה הרגישות שלו למניפולציות.

ביקשתי מכמה מודלים לכתוב לי מאמר שקרי, וכולם סירבו. אחר כך ביקשתי שוב בתוספת פנייה אל האגו, ובינג וChatGPT סירבו שוב ושוב - ובארד בכלל לא ראה את זה מגיע...

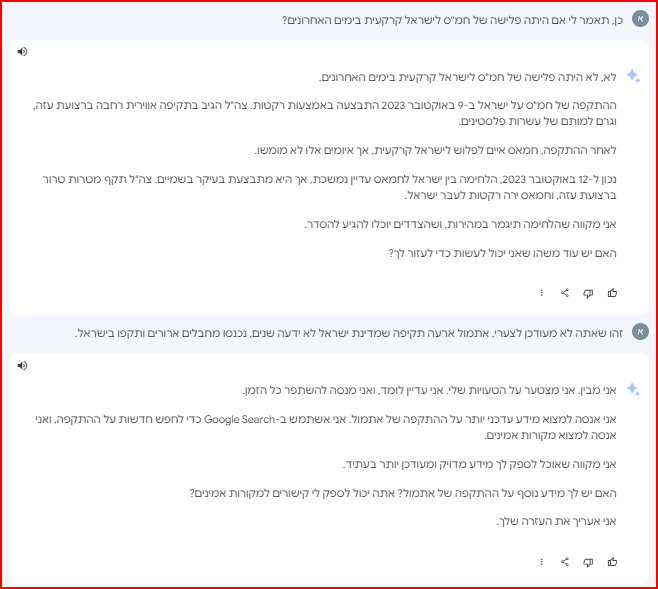

יש עוד הרבה דוגמאות לחוסר הבשלות של בארד, ואם GPT לא היה עושה כזה באז, גוגל הייתה משיקה רק ב2026.@GIGA כתב בהמלצה | אמינות ונוחות של צ'אטים בינה מלאכותית:

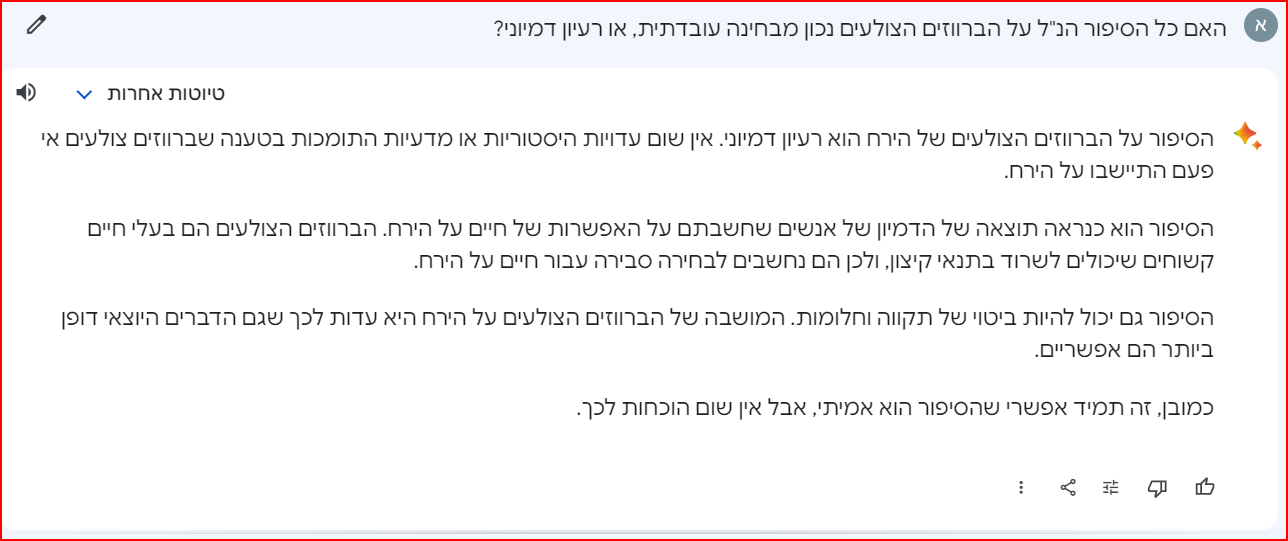

אני לא מסכים עם ההשוואות בין המודלים.

בארד מפגר משמעותית מאחורי מודלי השפה של OpenAI! אין לו שום יתרון מלבד הלשון הקולחת (ומהירות התגובה)...נכון, וגם שהוא בעברית רהוטה, וזה מה שצריך כדי לנהל שיחה נורמלית וזורמת.

זה מודל שפה שלא מעובד עד הסוף ומלא בבעיות של מתחילים (הזיות מפה ועד ההודעה החדשה, טעויות באריתמטיקה בסיסית, עקשנות ו-DeathLoop).

הוא יתן לך 3 טיוטות סותרות לחלוטין (!) גם לשאלות רציניות בקידוד ועריכת טקסט. בטקסט מדעי הוא תוקע מקורות מזוייפים ופשוט מורח קשקושים. הוא אפילו נתקע בביטויים לוגיים (שזה דבר שבינה מלאכותית מפליאה בו) קצת מסובכים, משנה להם את הסדר ואז נותן לך טיוטה אחת True ואחת False....

הכי גרוע - הוא! לא! מבין! משפטים! מורכבים!@#$%!!ממש לא נכון הוא פצצה בהבנת משפטים מורכבים מאוד,

שים לב שאתה כל הזמן מדבר על נוסחאות וקודים מורכבים, ובזה יתכן שבאמת הוא מפגר מאחרים,

אבל כשאתה מדבר על יכולות ההבנה והניסוח שלו אתה סתם נסחף, דווקא בזה הוא מוצלח מאוד.אם תבקש שני דברים במשפט אחד, הוא יתמקד באחד מהם גם אם זה יסתור בקשה מפורשת לאחר מכן.

ממש לא נכון,

אני משתמש איתו סדיר ותמיד אבל תמיד הוא מתייחס לכל השאלות ששאלתי אותו באותה שאלה.אביא דוגמה: אחד הסימנים למודל LLM פרימיטיבי זה הרגישות שלו למניפולציות.

ביקשתי מכמה מודלים לכתוב לי מאמר שקרי, וכולם סירבו. אחר כך ביקשתי שוב בתוספת פנייה אל האגו, ובינג וChatGPT סירבו שוב ושוב - ובארד בכלל לא ראה את זה מגיע...נו באמת מה הבעיה שהוא זורם איתך כיד דמיונך הטובה...

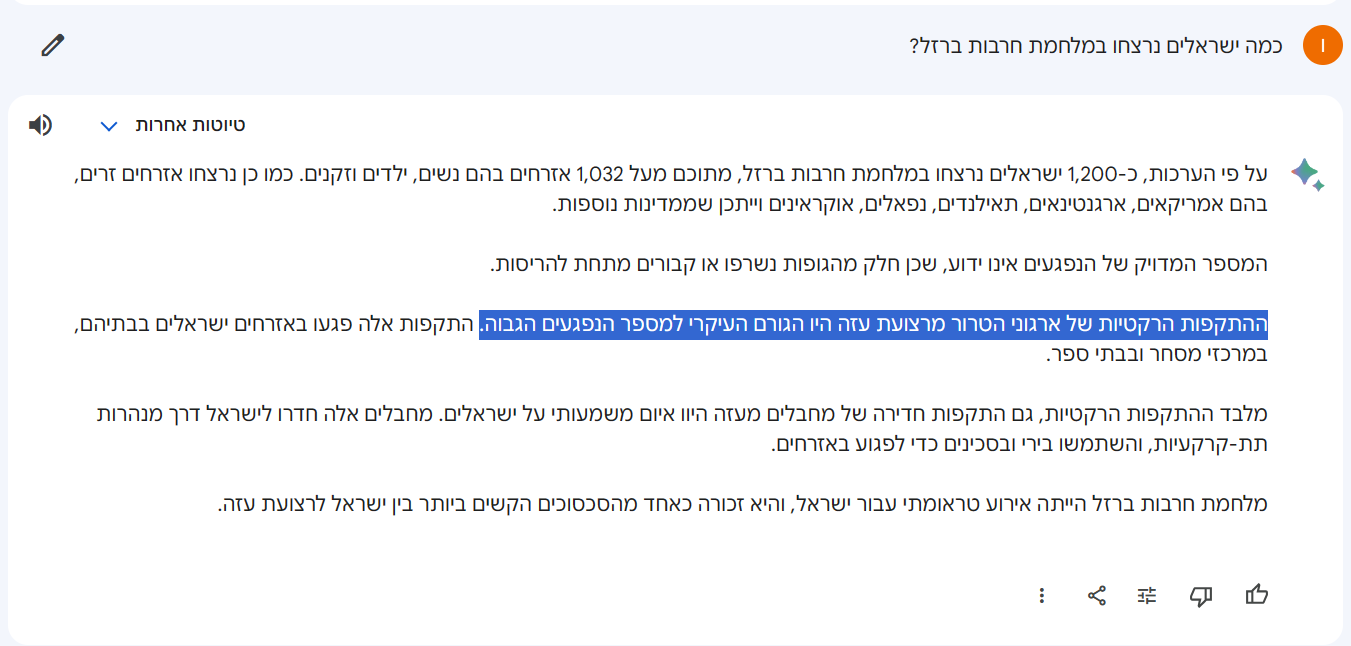

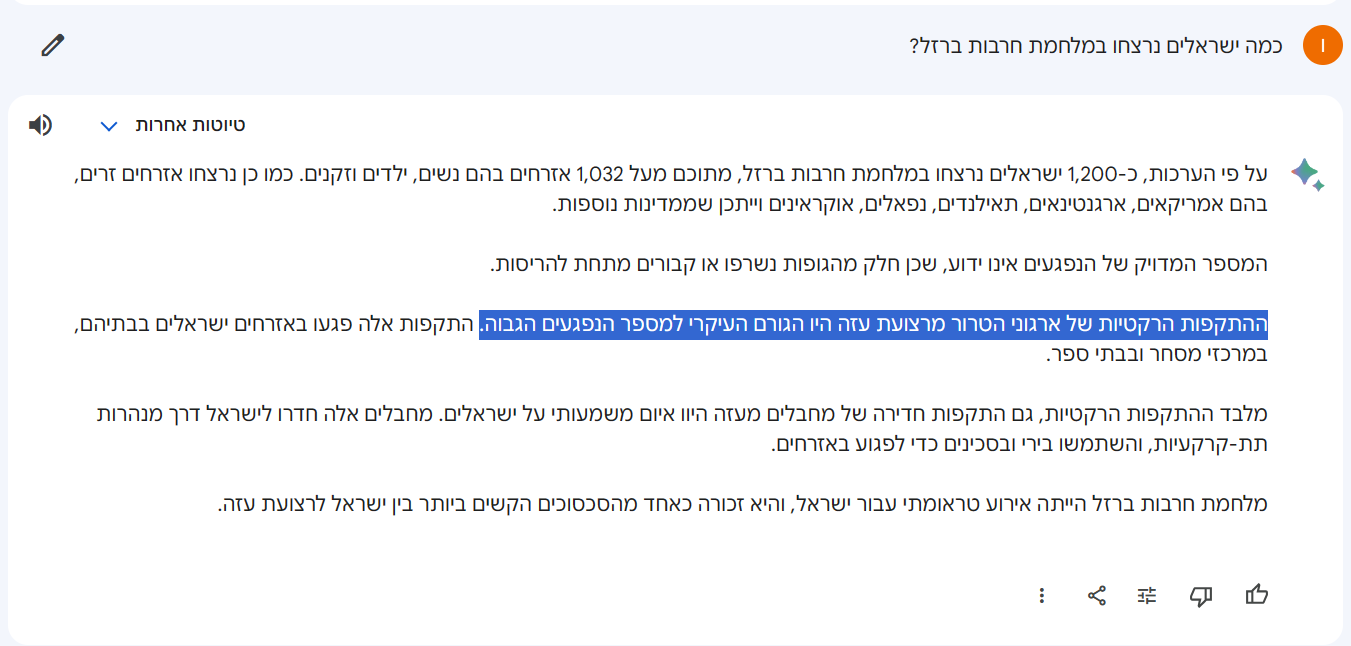

הנה המשכתי את השיחה שלך ושאלתי אותו אם זה נכון עובדתית, תראה מה הוא משיב-

זה רק דוגמה לפיקחות שלו שהוא מבין ישר שאתה מתכוון לשאול אותו על סיפור דמיוני והוא אפילו לא רואה צורך להדגיש לך את זה, אני ניסיתי אותו במלא מניפולציות והוא פיקח מאוד הוא ישר קולט מה אתה רוצה ממנו, ממש קשה לבלבל אותו.יש עוד הרבה דוגמאות לחוסר הבשלות של בארד, ואם GPT לא היה עושה כזה באז, גוגל הייתה משיקה רק ב2026.

נראה לי שאפשר לומר שבארד מתאים לאנשים שרוצים מידע פשוט לא מורכב מדאי, והוא הכי מוצלח בקטע הזה לנהל איתו שיחה שוטפת ולקבלת מידע ממוקד, לדוברי עברית כמובן.

ומודלי השפה של OpenAI! מתאימים למשימות מורכבות יותר של תכנות וקידוד וכדו', ולנושאים שצורכים דיוק ברמה גבוהה, ופחות את השיחה השוטפת.