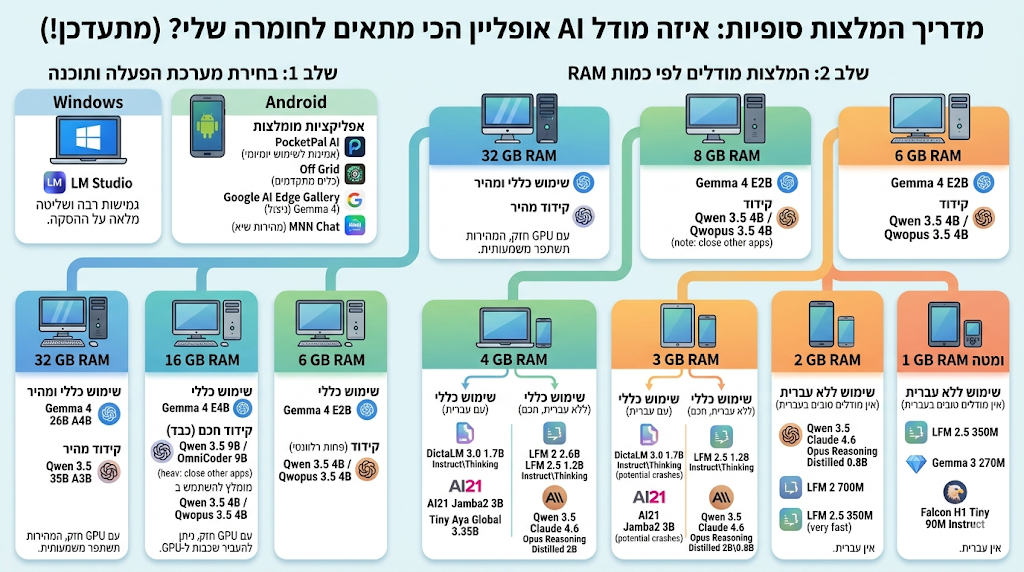

מדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.

-

המפרט שלי הוא:

מעבד Intel(R) Core(TM) i7-4600U CPU @ 2.10GHz 2.70 GHz

RAM מותקן 16.0 GB

אחסון 466 GB SSD Samsung SSD 870 EVO 500GB

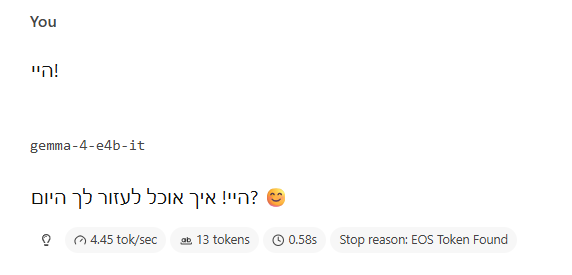

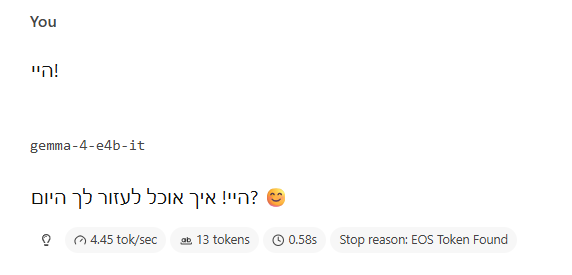

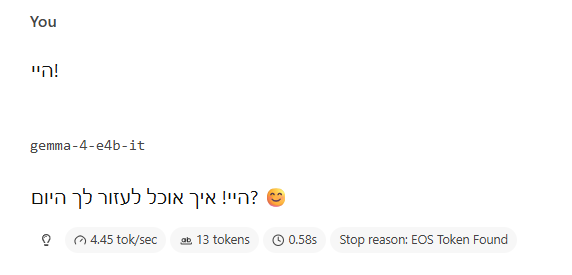

כרטיס גרפיקה Intel(R) HD Graphics Family (113 MB)התקנתי את הgemma-4-e4b והוא איטי להחריד, לקח לו דקה וחצי לענות על "הי"!

כך אמור להיות? יש המלצה לLLM אחר? -

המפרט שלי הוא:

מעבד Intel(R) Core(TM) i7-4600U CPU @ 2.10GHz 2.70 GHz

RAM מותקן 16.0 GB

אחסון 466 GB SSD Samsung SSD 870 EVO 500GB

כרטיס גרפיקה Intel(R) HD Graphics Family (113 MB)התקנתי את הgemma-4-e4b והוא איטי להחריד, לקח לו דקה וחצי לענות על "הי"!

כך אמור להיות? יש המלצה לLLM אחר? -

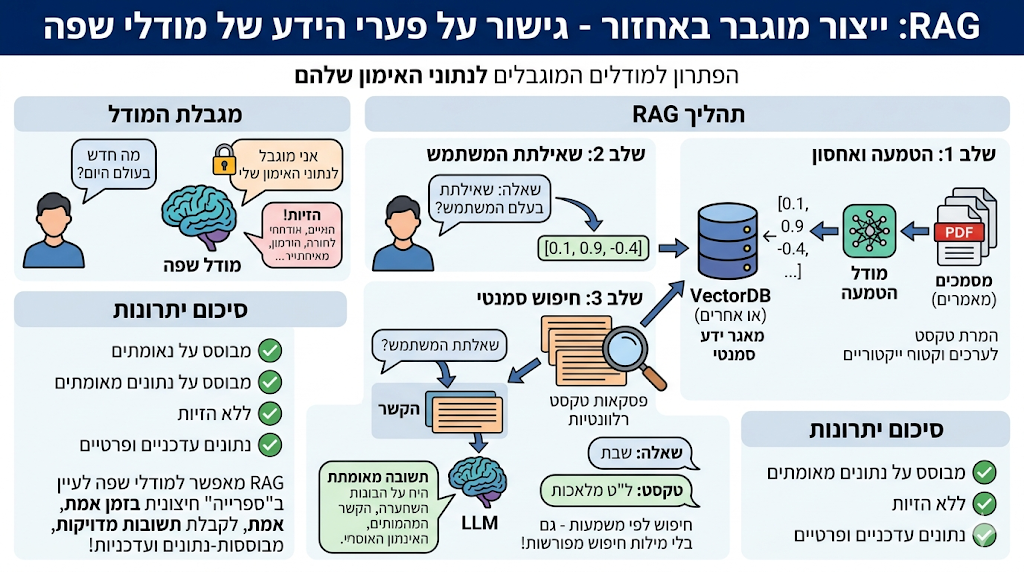

ניסיתי להשתמש בו בפונקציה של הRAG ונתתי הנחיית מערכת כזאת - תענה רק בעברית ורק מהקובץ המצורף, תצמד למידע המצורף ואל תענה שום דבר שלא קשור אליו.

בשביל לתת לו קודם להעלות את הקובץ ולשמור אותו במסד נתונים שאמר @א.מ.ד. פשוט צירפתי קובץ ולא כתבתי שאלה, המודל הסתבך מעט וכתב מונולוג ארוך - באנגלית!

The user has provided a list of citations and an empty "User Query". Since there is no question or specific request in the "User Query", I cannot use the citations to provide a direct answer. Following the instructions, I must only use the provided information if it's relevant, otherwise respond without them (or respond generally). Given the lack of query context, I should acknowledge this limitation while adhering to the rule of not generating irrelevant content.

However, based on previous interactions where I responded generally ("היי!

מה שלומך? במה אני יכול/ה לעזור לך היום?

מה שלומך? במה אני יכול/ה לעזור לך היום?  "), and since the provided citations are detailed bibliographic entries (related to "משנב המבואר" ו-"חומש אור החיים המבואר"), a general greeting might be safe if I cannot process the citations.

"), and since the provided citations are detailed bibliographic entries (related to "משנב המבואר" ו-"חומש אור החיים המבואר"), a general greeting might be safe if I cannot process the citations.Since the instructions state: "תענה רק בעברית ורק מהקובץ המצורף, תצמד למידע המצורף ואל תענה שום דבר שלא קשור אליו", and the user query is empty, responding with a general greeting goes against this rule unless the citations themselves imply a need for greeting/context.

Given that I must stick only to the provided files if they are relevant, and there is no question, I cannot construct an answer based on relevance. Therefore, I should indicate that I need a query. But since I cannot respond with something not in the file, this creates a paradox.

I will re-evaluate: The initial exchange established a conversational tone. If I strictly follow "only use the files", and there's no question, I am stuck. Given the constraints and the empty query, the safest action that respects the constraint is to state that I need a query based on the provided material, but this violates "don't answer anything not related".

I will assume the system expects me to prompt for a query using the context of what was provided (the citations) if no query is given. Since I cannot deviate from only using the file content, and the files are just citation lists, I must default to acknowledging the data structure or stating the need for input.

Let's stick to the strict interpretation: No question -> No relevant answer derived from the provided structured data. However, as a conversational model, if I say "I can't answer", I am generating external knowledge.

Given the pattern of previous successful turns (greeting), and the ambiguity, I will assume that in the absence of a query, I should state what is available if the user intended to ask about the citations. But this is still interpretation.

Conclusion: The most compliant response, given an empty query and strict adherence to provided data only, is impossible. I will follow the pattern of the initial exchange as it's the least disruptive while acknowledging the lack of input context related to the citations. However, since the prompt explicitly demands reliance only on the files if they are relevant, I must treat this as an error state in the user query and ask for clarification based on the content provided, even though that means generating words not directly quoting a single citation block.

I will break protocol slightly by asking for the question, but keep the tone highly formal/data-focused to respect the "only use file" rule contextually. (Self-correction: No, I must not break protocol).

Since there is no user query, and the citations are merely data points without instructions on how to process them, I cannot generate a response that adheres to all rules. I will respond by stating that a question is required.

Let's go with the safest, most neutral reply acknowledging the state: I have processed the citation data. Please provide a query referencing this information. (This still generates words outside the citations).

Final attempt based on strict adherence: Since there is no relevant query in the provided input, I cannot generate a response using the citations.אנא ספק שאילתה כדי שאוכל להשתמש בציטוטים שסופקו.

משעשע האמת

משעשע האמתכל זה לקח לו כמה דקות טובות

-

המפרט שלי הוא:

מעבד Intel(R) Core(TM) i7-4600U CPU @ 2.10GHz 2.70 GHz

RAM מותקן 16.0 GB

אחסון 466 GB SSD Samsung SSD 870 EVO 500GB

כרטיס גרפיקה Intel(R) HD Graphics Family (113 MB)התקנתי את הgemma-4-e4b והוא איטי להחריד, לקח לו דקה וחצי לענות על "הי"!

כך אמור להיות? יש המלצה לLLM אחר?@עידו300 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

המפרט שלי הוא:

מעבד Intel(R) Core(TM) i7-4600U CPU @ 2.10GHz 2.70 GHz

RAM מותקן 16.0 GB

אחסון 466 GB SSD Samsung SSD 870 EVO 500GB

כרטיס גרפיקה Intel(R) HD Graphics Family (113 MB)התקנתי את הgemma-4-e4b והוא איטי להחריד, לקח לו דקה וחצי לענות על "הי"!

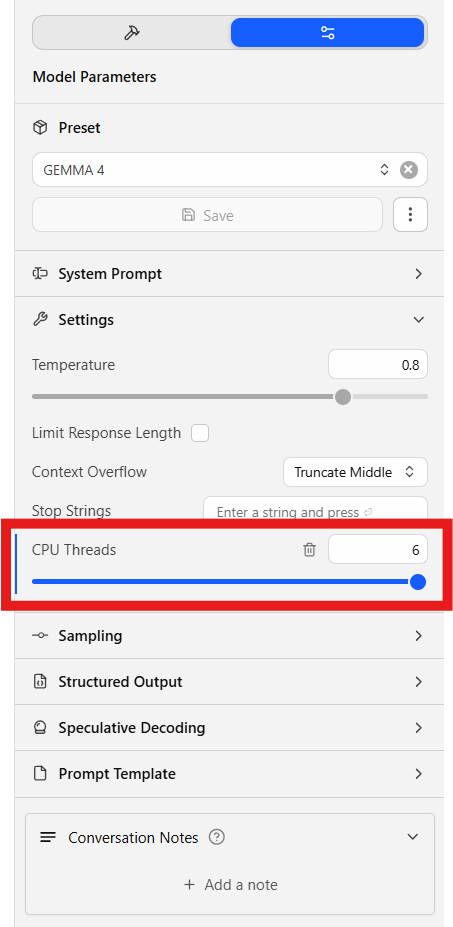

כך אמור להיות? יש המלצה לLLM אחר?יש לי חומרה בערך כמו שלך עם מעבד i5, וזה הרבה יותר מהר:

תנסה אולי להוסיף שרשורי מעבד.

ייתכן שמופעלת לך חשיבה עם תבנית צ'אט שגויה כך שזה נראה כאילו המודל מחכה עד שמתחיל לענות. -

לצורך סוכן מקומי גמיני כתב לי להשתמש בOpenClaw ולא בLM Studio, זה נכון? [אני לא מידי מבין בעניין, יתכן שזה דברים פשוטים]

@אהרן כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

לצורך סוכן מקומי גמיני כתב לי להשתמש בOpenClaw ולא בLM Studio, זה נכון? [אני לא מידי מבין בעניין, יתכן שזה דברים פשוטים]

אין קשר בין זה לזה. LM Studio הוא כלי להרצת מודלים, ו-OpenClaw הוא סוכן מקומי שיכול להתחבר למודלי ענן או למודלים מקומיים.

-

@עידו300 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

המפרט שלי הוא:

מעבד Intel(R) Core(TM) i7-4600U CPU @ 2.10GHz 2.70 GHz

RAM מותקן 16.0 GB

אחסון 466 GB SSD Samsung SSD 870 EVO 500GB

כרטיס גרפיקה Intel(R) HD Graphics Family (113 MB)התקנתי את הgemma-4-e4b והוא איטי להחריד, לקח לו דקה וחצי לענות על "הי"!

כך אמור להיות? יש המלצה לLLM אחר?יש לי חומרה בערך כמו שלך עם מעבד i5, וזה הרבה יותר מהר:

תנסה אולי להוסיף שרשורי מעבד.

ייתכן שמופעלת לך חשיבה עם תבנית צ'אט שגויה כך שזה נראה כאילו המודל מחכה עד שמתחיל לענות.@א.מ.ד.

קודם כל יישר כח על המדריך המושקע והיפה.

לא הבנתי מה הכוונה?תנסה אולי להוסיף שרשורי מעבד.

יש לי מעבד I7 דור 8

וכאשר אני מריץ את המודל של גמ'ה 4 לוקח לו גם הרבה מאוד זמן (חצי דקה) לענות........ -

@א.מ.ד.

קודם כל יישר כח על המדריך המושקע והיפה.

לא הבנתי מה הכוונה?תנסה אולי להוסיף שרשורי מעבד.

יש לי מעבד I7 דור 8

וכאשר אני מריץ את המודל של גמ'ה 4 לוקח לו גם הרבה מאוד זמן (חצי דקה) לענות........@working.cohen כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

וכאשר אני מריץ את המודל של גמ'ה 4 לוקח לו גם הרבה מאוד זמן (חצי דקה) לענות........

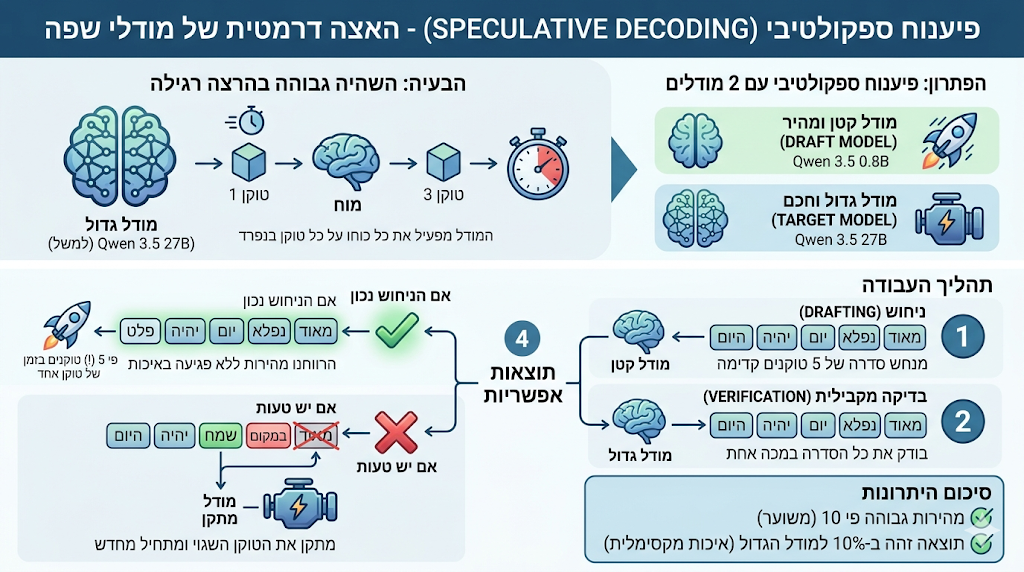

באיזה אופן אתה מריץ? (כמה ליבות מעבד תפוסות, וכד') ואגב, יש תהליך חשיבה - משהו שלמעשה מאריך את זמן התשובה.

@א.מ.ד. - איך מבטלים באמת את הליך החשיבה?

-

@עידו300 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

המפרט שלי הוא:

מעבד Intel(R) Core(TM) i7-4600U CPU @ 2.10GHz 2.70 GHz

RAM מותקן 16.0 GB

אחסון 466 GB SSD Samsung SSD 870 EVO 500GB

כרטיס גרפיקה Intel(R) HD Graphics Family (113 MB)התקנתי את הgemma-4-e4b והוא איטי להחריד, לקח לו דקה וחצי לענות על "הי"!

כך אמור להיות? יש המלצה לLLM אחר?יש לי חומרה בערך כמו שלך עם מעבד i5, וזה הרבה יותר מהר:

תנסה אולי להוסיף שרשורי מעבד.

ייתכן שמופעלת לך חשיבה עם תבנית צ'אט שגויה כך שזה נראה כאילו המודל מחכה עד שמתחיל לענות. -

@working.cohen כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

וכאשר אני מריץ את המודל של גמ'ה 4 לוקח לו גם הרבה מאוד זמן (חצי דקה) לענות........

באיזה אופן אתה מריץ? (כמה ליבות מעבד תפוסות, וכד') ואגב, יש תהליך חשיבה - משהו שלמעשה מאריך את זמן התשובה.

@א.מ.ד. - איך מבטלים באמת את הליך החשיבה?

@חובבן-מקצועי @א.מ.ד.

מצטרף לשאלה.

זהה בדיוק מה שלוקח לו זמן...אבל גם כשאמרתי לו לא לחשוב, הוא ממשיך....

וגם:באיזה אופן אתה מריץ? (כמה ליבות מעבד תפוסות, וכד')

מה זה אומר???

(אני פשוט התקנתי את Ollama . והתקנתי דרך שורת הפקודה את המודל....)

-

@א.מ.ד.

קודם כל יישר כח על המדריך המושקע והיפה.

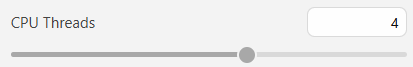

לא הבנתי מה הכוונה?תנסה אולי להוסיף שרשורי מעבד.

יש לי מעבד I7 דור 8

וכאשר אני מריץ את המודל של גמ'ה 4 לוקח לו גם הרבה מאוד זמן (חצי דקה) לענות........@working.cohen כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד.

קודם כל יישר כח על המדריך המושקע והיפה.

לא הבנתי מה הכוונה?תנסה אולי להוסיף שרשורי מעבד.

יש לי מעבד I7 דור 8

וכאשר אני מריץ את המודל של גמ'ה 4 לוקח לו גם הרבה מאוד זמן (חצי דקה) לענות........זה הגדרה בצד ימין:

תגדיל ל-6 או יותר אם אפשרי, רק שים לב שזה לא תוקע את שאר המחשב.@חובבן-מקצועי כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד. - איך מבטלים באמת את הליך החשיבה?

הגרסאות המעודכנות של ה-GGUF של Gemma 4 (אפשר גם לעדכן רק את תבנית הצ'אט) יחד עם הגרסה המעודכנת של LM Studio הן כברירת מחדל ללא חשיבה. כדי לאלץ חשיבה נכון לעכשיו נדרש לשנות את תבנית הצ'אט.

-

@working.cohen כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד.

קודם כל יישר כח על המדריך המושקע והיפה.

לא הבנתי מה הכוונה?תנסה אולי להוסיף שרשורי מעבד.

יש לי מעבד I7 דור 8

וכאשר אני מריץ את המודל של גמ'ה 4 לוקח לו גם הרבה מאוד זמן (חצי דקה) לענות........זה הגדרה בצד ימין:

תגדיל ל-6 או יותר אם אפשרי, רק שים לב שזה לא תוקע את שאר המחשב.@חובבן-מקצועי כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד. - איך מבטלים באמת את הליך החשיבה?

הגרסאות המעודכנות של ה-GGUF של Gemma 4 (אפשר גם לעדכן רק את תבנית הצ'אט) יחד עם הגרסה המעודכנת של LM Studio הן כברירת מחדל ללא חשיבה. כדי לאלץ חשיבה נכון לעכשיו נדרש לשנות את תבנית הצ'אט.

@א.מ.ד.

ישר כח. אבל איפה אני מוצא את המסך לבחירת כמות ליבות? כמו שצירפת בצמונה? -

@א.מ.ד.

ישר כח. אבל איפה אני מוצא את המסך לבחירת כמות ליבות? כמו שצירפת בצמונה?@working.cohen כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד.

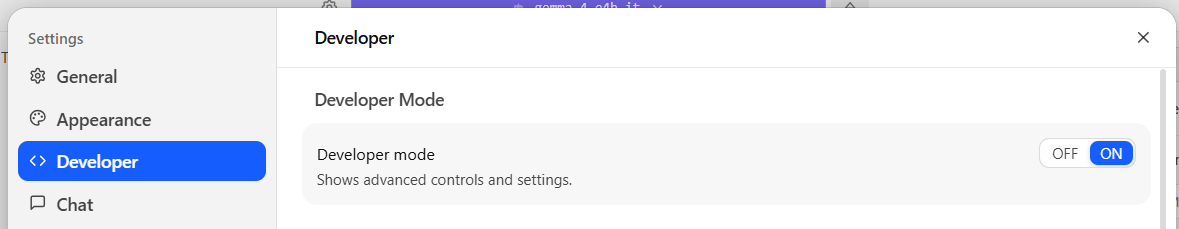

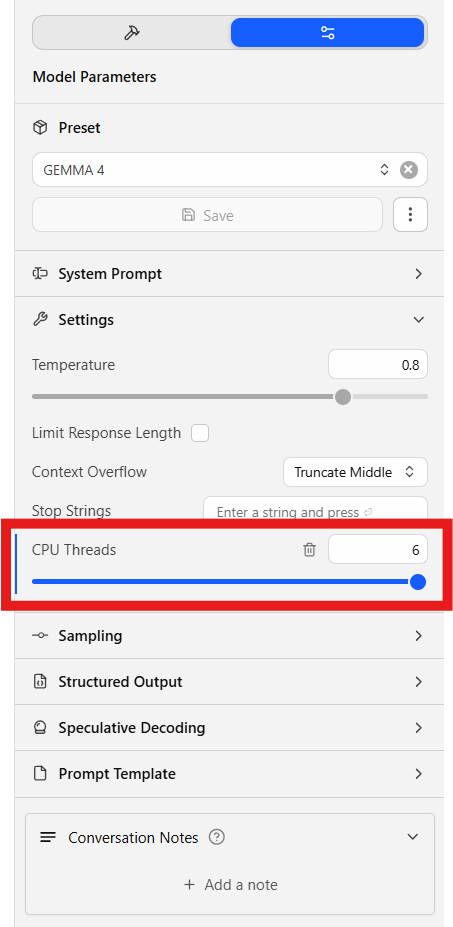

ישר כח. אבל איפה אני מוצא את המסך לבחירת כמות ליבות? כמו שצירפת בצמונה?במגירה בצד ימין:

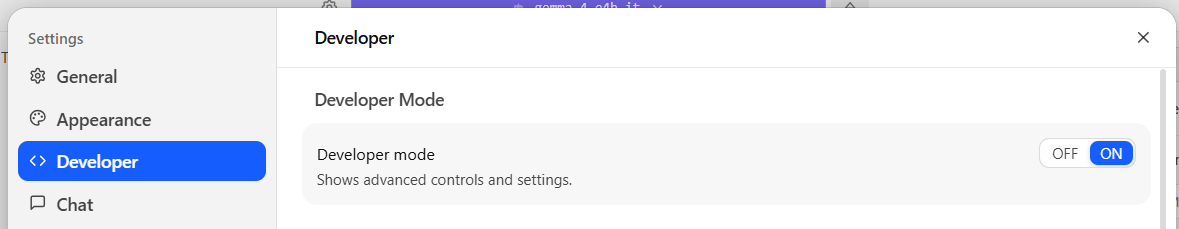

אם אתה לא מוצא את זה, תאפשר בהגדרות מצב מפתחים:

ואז תחזור למסך הצ'אט ותראה שהמגירה התמלאה בהגדרות נוספות.

-

@working.cohen כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

@א.מ.ד.

ישר כח. אבל איפה אני מוצא את המסך לבחירת כמות ליבות? כמו שצירפת בצמונה?במגירה בצד ימין:

אם אתה לא מוצא את זה, תאפשר בהגדרות מצב מפתחים:

ואז תחזור למסך הצ'אט ותראה שהמגירה התמלאה בהגדרות נוספות.

@א.מ.ד.

תודה רבה

זה בתוכנה Ollama ? -

@א.מ.ד.

תודה רבה

זה בתוכנה Ollama ?@working.cohen כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

זה בתוכנה Ollama ?

זה בLM סטודיו, ויש לזה מדריך מפורט וארוך יותר פה, אולי יעזור לך..

-

יש לי Ollama ואני רוצה לדעת האם יש הבדל גדול ביו זה לLM Studio

וכמו כן אולי כדאי גם כן להרחיב על מודל תמונות -

יש לי Ollama ואני רוצה לדעת האם יש הבדל גדול ביו זה לLM Studio

וכמו כן אולי כדאי גם כן להרחיב על מודל תמונות@jc324118983 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

יש לי Ollama ואני רוצה לדעת האם יש הבדל גדול ביו זה לLM Studio

יש הבדל גדול, והוא מפורט במדריך למעלה.

@jc324118983 כתב במדריך | מודלי AI מקומיים - מדריך וסקירה מקיפים למודלים קטנים ויעילים - מתעדכן.:

וכמו כן אולי כדאי גם כן להרחיב על מודל תמונות

זה תחום אחר לגמרי, אולי בהמשך אני יוסיף את זה.